Utvecklingen av grafikteknik har historiskt sett fokuserat på ökad råstyrka och större fysiskt minne.

Nvidia presenterar nu ett paradigmskifte genom introduktionen av Neural Texture Compression, en innovativ metod som adresserar en av de största flaskhalsarna inom modern spelutveckling: videominnesanvändning (VRAM). Genom att implementera avancerad maskininlärning kan tekniken reducera belastningen på hårdvaran dramatiskt utan att tumma på den visuella upplevelsen.

Effektivisering av texturhantering via maskininlärning

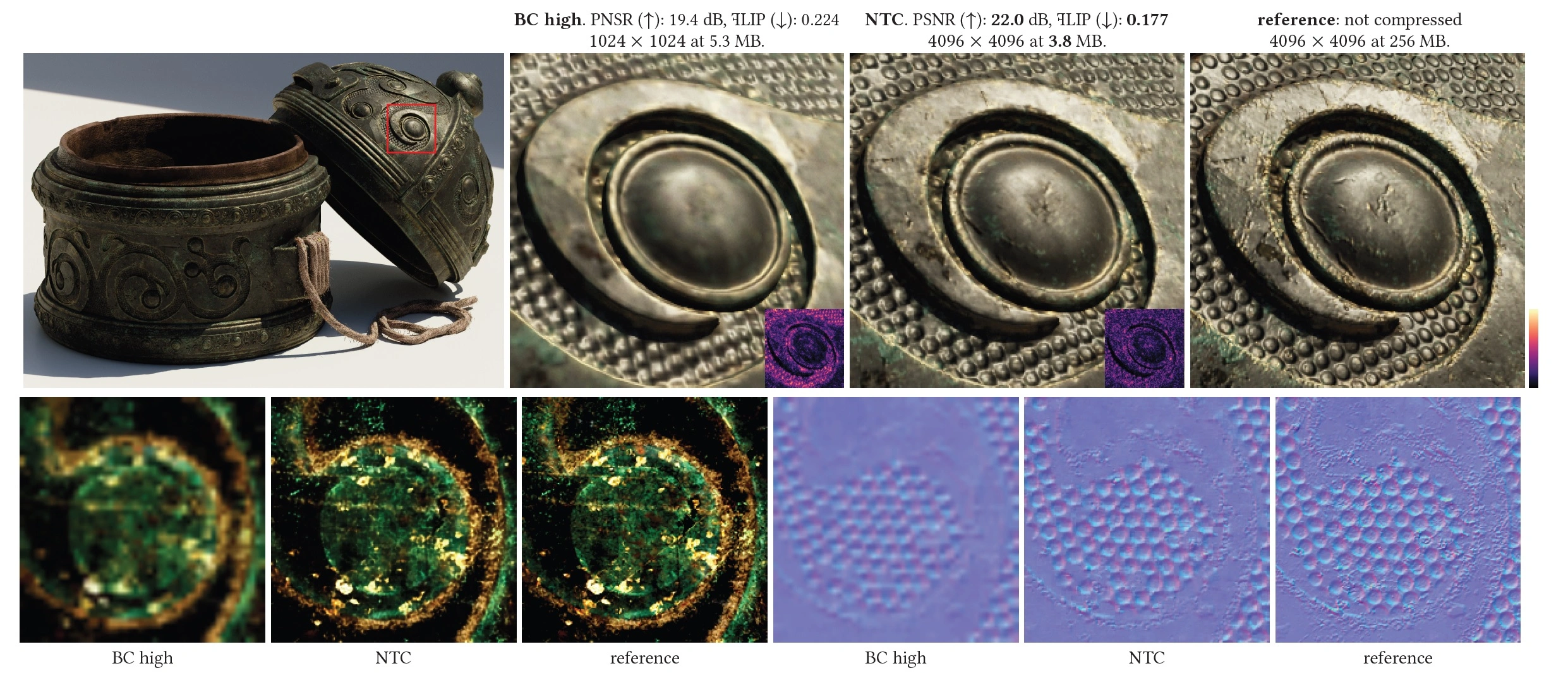

Traditionellt lagras texturer i fasta, högupplösta format, vilket kräver enorma mängder lagringsutrymme och minnesbandbredd. Neural Texture Compression förändrar detta fundamentalt genom att frångå lagring av fullständig rådata. Istället använder tekniken intelligenta algoritmer för att rekonstruera detaljrika ytor i realtid. Enligt de senaste tekniska rapporterna möjliggör detta en minskning av minnesåtgången med upp till 85 procent. Resultatet är en bibehållen bildkvalitet trots en bråkdel av den ursprungliga datamängden.

Från statisk lagring till intelligent rekonstruktion

Kärnan i genombrottet ligger i hur data tolkas av grafikprocessorn. Genom att komprimera texturer till en tjugofjärdedel av deras ursprungliga storlek i extrema fall, kan utvecklare frigöra resurser till andra krävande processer, såsom raytracing eller komplex fysiksimulering. Detta innebär att framtidens spel kan bli betydligt mer detaljerade utan att kräva orimliga mängder fysiskt VRAM på grafikkorten.

Deterministisk arkitektur för maximal stabilitet

En kritisk aspekt av Neural Texture Compression är dess deterministiska natur. Till skillnad från generativa AI-modeller, som ibland kan producera varierande eller oförutsägbara resultat, garanterar denna teknik att samma indata alltid resulterar i exakt samma utdata. Detta eliminerar risken för grafiska artefakter, brus eller slumpmässiga avvikelser i bilden. För spelutvecklare är denna stabilitet ett absolut krav för att kunna säkerställa en enhetlig upplevelse för alla användare, oavsett hårdvarukonfiguration.

Matrix Engine och utnyttjande av Tensor-kärnor

För att säkerställa att den totala systemprestandan inte påverkas negativt flyttas beräkningsbördan för Neural Texture Compression till dedikerad hårdvara. Processen sker inom ramarna för vad som kallas Matrix Engine och exekveras primärt av grafikkortets Tensor-kärnor. Genom att separera komprimeringsarbetet från de generella CUDA-kärnorna bibehålls renderingshastigheten och den generella beräkningskraften.

Framtidens krav på RTX-hårdvara

Tekniken är utformad för att fungera sömlöst med modern arkitektur. För kommande generationers hårdvara, exempelvis RTX 50-serien, kan detta innebära att begränsningar i minnesmängd blir mindre kännbara. När mjukvaruoptimeringar som Neural Texture Compression blir standard, skiftas fokus från ren hårdvarukapacitet till hur effektivt existerande resurser kan utnyttjas genom intelligent mjukvara.

Sammanfattning av teknikens potential

Nvidias framsteg inom neural komprimering markerar början på en ny era för grafikrendering. Genom att kombinera maskininlärning med dedikerad hårdvaruacceleration skapas förutsättningar för mer fotorealistiska miljöer och effektivare resursanvändning. Om industrin väljer att anamma Neural Texture Compression som en ny standard kan vi förvänta oss en framtid där gränserna för vad som är möjligt att rendera i realtid förflyttas avsevärt, även på konsumentnära hårdvara.