Apple introducerar en rad nya AI-funktioner under samlingsnamnet Apple Intelligence, med förbättringar inom översättning, bildgenerering, skärmanalys och träning.

Samtidigt släpper man ett nytt ramverk som gör det möjligt för tredjepartsutvecklare att integrera den lokala språkmodellen direkt i sina appar – utan behov av molntjänster.

Liveöversättning och bildgenerering direkt på enheten

En av de största nyheterna är realtidsöversättning i Meddelanden, Facetime och Telefonsamtal. Översättningen sker helt lokalt på enheten och skickar ingen information till externa servrar. Funktionen är därmed ett tydligt steg mot starkare integritet.

Bildfunktionerna har också fått ett rejält lyft. I Image Playground och via Genmoji kan användare nu skapa bilder med textbeskrivningar – i kombination med emojis. Bildgenereringen sker via ChatGPT:s bildmotor, men inget skickas till Apple innan användaren godkänner.

Visuell intelligens analyserar skärminnehåll

Med hjälp av visuell intelligens kan användare få information om vad som visas på skärmen – allt från objektidentifiering till kalenderförslag. Funktionen aktiveras med samma knappkombination som används för att ta skärmbilder, vilket gör den lättillgänglig i vardagen.

Apple Watch får smart träningspartner

En ny funktion, Workout Buddy, använder sensordata från Apple Watch för att analysera träningspass i realtid. Genom att kombinera puls, tempo och träningshistorik kan systemet ge återkoppling med ett genererat röstläge. Det kräver dock att en iPhone med stöd för Apple Intelligence finns i närheten.

Utvecklare får tillgång till Apples språkmodell

Apple lanserar nu Foundation Models, ett nytt ramverk som gör det möjligt för utvecklare att bygga in AI direkt i appar. Språkmodellen kan köras lokalt, vilket innebär att appar inte behöver vara beroende av molnbaserade API:er.

Ramverket är djupt integrerat med Swift och erbjuder stöd för textgenerering, verktygskoppling och kontrollmekanismer.

Exempel på användningsområden inkluderar appar för utbildning som automatiskt skapar frågesporter, eller friluftsappar med naturlig språkbaserad sökning.

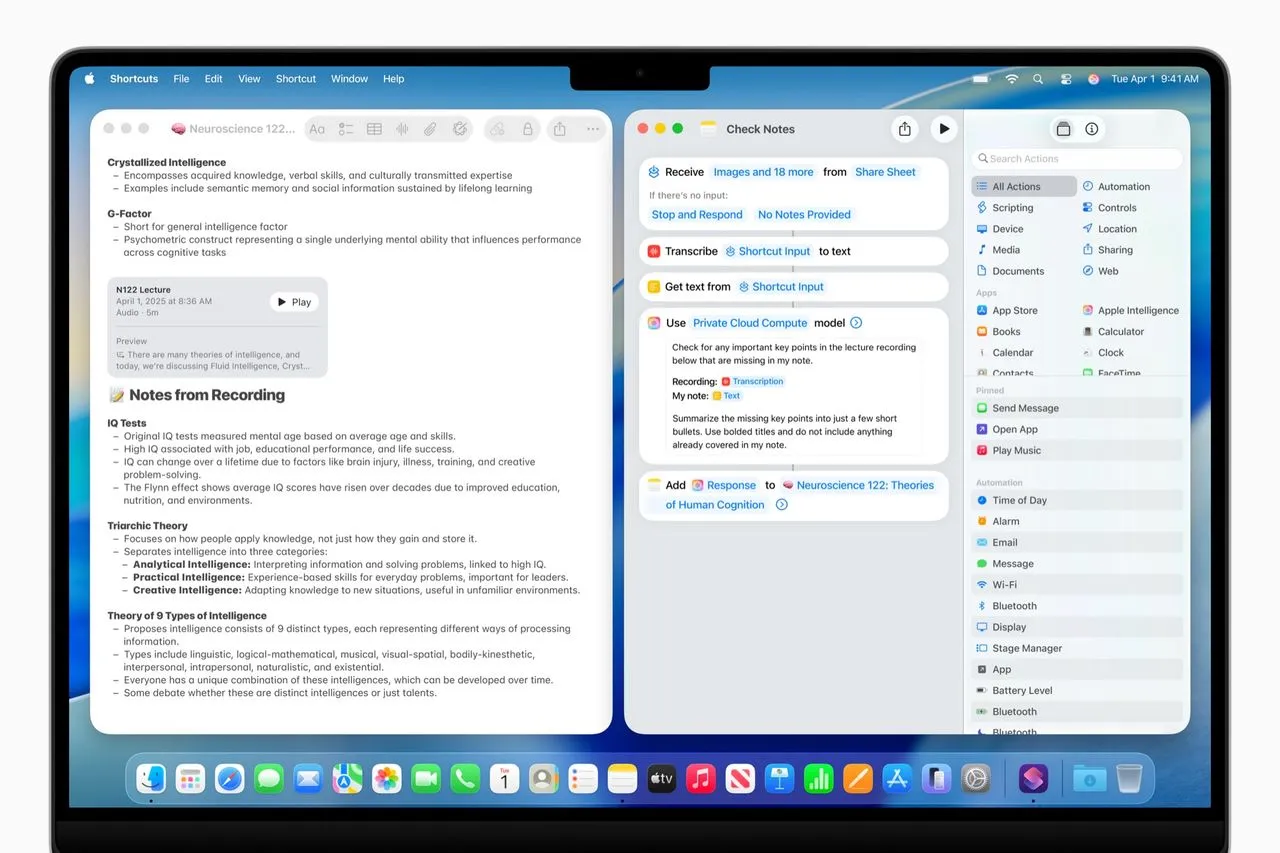

Genvägar och appar får AI-stöd

Apples Genvägar har nu tillgång till Apple Intelligence och kan hantera data antingen lokalt eller via Private Cloud Compute. Det möjliggör automatiserade arbetsflöden där innehåll analyseras, bearbetas eller skapas – allt utan att lämna användarens ekosystem.

Dessutom integreras funktionerna direkt i flera befintliga appar:

- Meddelanden: Får omröstningsförslag och anpassningsbara bakgrunder

- Wallet: Visar leveransöversikter

- Bilder: Möjliggör radering och analys av objekt

- Mail: Erbjuder snabbsvar och automatiska sammanfattningar

- Siri: Kan ta emot textkommandon och utnyttja ChatGPT

- Safari: Förbättrar integritetsskyddet

Integritet i fokus

Apple betonar att majoriteten av funktionerna körs direkt på enheten. När molnkapacitet används sker det via Private Cloud Compute, där Apple garanterar att data enbart används för att besvara specifika förfrågningar och därefter raderas. Koden är dessutom tillgänglig för oberoende säkerhetsgranskning.

Lansering i höst – på svenska

Apple Intelligence finns nu tillgängligt för utvecklare genom Apple Developer Program. En publik beta kommer nästa månad, och en skarp lansering sker i höst för iPhone 16, iPhone 15 Pro samt iPads och Macs med M1-chip eller nyare.

Funktionen har fullständigt stöd för svenska – något som länge efterfrågats av användare i Sverige.